Yapay Zeka Hackleme Nedir?

Yapay zeka korsanlığı, siber saldırıları geliştirmek veya otomatikleştirmek için yapay zekanın kullanılmasıdır. Tehdit aktörlerinin kod oluşturmasına, sistemleri analiz etmesine ve minimum manuel çabayla savunmalardan kaçmasına olanak tanır.

Yapay zeka modelleri, özellikle de büyük dil modelleri (LLM'ler), saldırı geliştirmeyi daha hızlı, daha ucuz ve daha az deneyimli bilgisayar korsanları için daha erişilebilir hale getiriyor. Sonuç, daha hızlı, daha ölçeklenebilir ve geleneksel savunmalarla durdurulması genellikle daha zor olan yeni bir dizi yapay zeka saldırısıdır.

Yapay Zeka Hacker'ı nedir?

YZ hacker, siber saldırıları otomatikleştirmek, geliştirmek veya ölçeklendirmek için yapay zeka kullanan bir tehdit aktörüdür. Yapay zeka korsanları, güvenlik kontrollerini atlamak, son derece ikna edici kimlik avı saldırıları hazırlamak ve yazılım açıklarından geniş ölçekte yararlanmak için makine öğrenimi modellerini, üretken yapay zekayı ve otonom ajanları kullanır.

Bu saldırganlar hem YZ araçlarını kullanan insan operatörleri hem de minimum insan girdisiyle görevleri yerine getiren yarı otonom sistemleri içerebilir. YZ kullanan insan saldırganlar, saldırı yeteneklerini artırmak için YZ modellerini kullanan gerçek dünyadaki bireylerdir (suçlular, script kiddie'ler, hacktivistler veya ulus-devlet aktörleri).

Otonom bilgisayar korsanlığı ajanları, keşif, yük oluşturma ve kaçma gibi görevleri minimum gözetimle zincirleyebilen yapay zeka güdümlü iş akışlarıdır. İnsan tarafından tanımlanan hedefler tarafından yönlendirilmeye devam etse de, bu ajanlar bir kez başlatıldıktan sonra yarı bağımsız olarak çalışabilir ve çok adımlı saldırıları manuel araçlardan daha verimli bir şekilde gerçekleştirebilir.

Yapay Zeka Siber Suçlarda Nasıl Kullanılıyor?

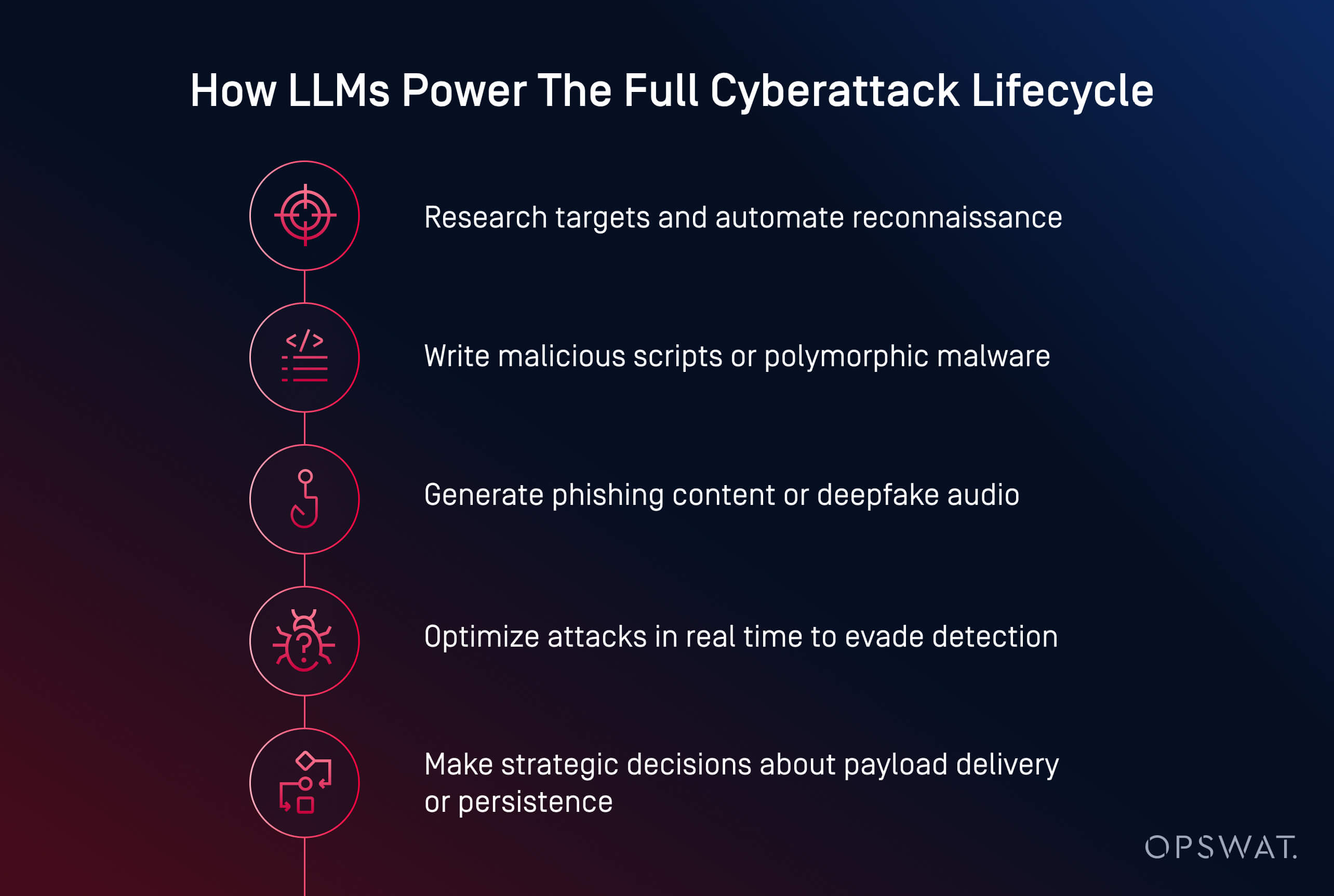

Yapay zeka tehdit aktörleri artık daha hızlı, daha akıllı ve daha uyarlanabilir siber saldırılar başlatmak için yapay zekayı kullanıyor. Yapay zeka, kötü amaçlı yazılım oluşturmadan kimlik avı otomasyonuna kadar siber suçları ölçeklenebilir bir operasyona dönüştürüyor. Artık kötü amaçlı kod üretebiliyor, ikna edici kimlik avı içeriği yazabiliyor ve hatta saldırganlara tam saldırı zincirleri boyunca rehberlik edebiliyor.

Siber suçlular yapay zekayı birkaç temel alanda kullanmaktadır:

- Yük oluşturma: HackerGPT ve WormGPT gibi araçlar gizlenmiş kötü amaçlı yazılımlar yazabilir, kaçınma taktiklerini otomatikleştirebilir ve komut dosyalarını yürütülebilir dosyalara dönüştürebilir. Bunlar, modellerin otonom kararlar aldığı yapay zeka ajanı siber saldırılarında sıklıkla görülen üretken yapay zeka saldırılarının örnekleridir.

- Sosyal mühendislik: Yapay zeka, kurbanları daha etkili bir şekilde manipüle etmek için gerçekçi kimlik avı e-postaları oluşturur, sesleri klonlar ve deepfake'ler üretir.

- Keşif ve planlama: Yapay zeka hedef araştırmasını, altyapı haritalamasını ve güvenlik açığı tespitini hızlandırır.

- Geniş ölçekte otomasyon: Saldırganlar, minimum insan girdisi ile çok aşamalı kampanyalar başlatmak için yapay zekayı kullanıyor.

Ponemon Enstitüsü'ne göre yapay zeka, fidye yazılımı kampanyalarında ve kimlik bilgilerinin çalınması ve 2023'teki bir ihlal sırasında 300'den fazla perakende satış noktasının zorla kapatılması da dahil olmak üzere büyük operasyonel aksaklıklara neden olan kimlik avı saldırılarında kullanıldı.

Ortaya çıkan birkaç model tehdit ortamını yeniden şekillendiriyor:

- Siber saldırıların demokratikleşmesi: Saldırı için ince ayarlanmış LLaMA gibi açık kaynaklı modeller artık yerel bilgi işlem gücüne sahip herkes tarafından kullanılabilir

- Daha düşük giriş engeli: Bir zamanlar uzman becerileri gerektiren şeyler artık basit istemler ve birkaç tıklama ile yapılabiliyor

- Kaçınma başarısında artış: Yapay zeka tarafından üretilen kötü amaçlı yazılımlar statik algılamadan, kum havuzlarından ve hatta dinamik analizden saklanmada daha başarılıdır

- Hizmet olarak kötü amaçlı yazılım (MaaS) modelleri: Siber suçlular yapay zeka yeteneklerini abonelik tabanlı kitlerde bir araya getirerek karmaşık saldırıları geniş ölçekte başlatmayı kolaylaştırıyor

- Gerçek dünya ihlallerinde yapay zeka kullanımı: Ponemon Enstitüsü, saldırganların fidye yazılımı hedeflemesini otomatikleştirmek için yapay zekayı kullandığını ve büyük operasyonların kapatılmasına neden olan olayların da buna dahil olduğunu bildiriyor

Yapay Zeka Destekli Kimlik Avı ve Sosyal Mühendislik

Yapay zeka destekli kimlik avı ve sosyal mühendislik, geleneksel dolandırıcılıkları tespit edilmesi daha zor olan ölçeklenebilir, kişiselleştirilmiş saldırılara dönüştürüyor. Tehdit aktörleri artık inandırıcı e-postalar oluşturmak, sesleri klonlamak ve hatta hedeflerini manipüle etmek için sahte video görüşmeleri üretmek için üretken modeller kullanıyor.

Geleneksel dolandırıcılıkların aksine, yapay zeka tarafından üretilen kimlik avı e-postaları cilalı ve ikna edicidir. ChatGPT ve WormGPT gibi araçlar iç iletişim, müşteri hizmetleri erişimi veya İK güncellemelerini taklit eden mesajlar üretir. İhlal edilen verilerle eşleştirildiğinde, bu e-postalar kişiselleştirilmiş ve başarılı olma olasılığı daha yüksek hale gelir.

Yapay zeka aynı zamanda yeni sosyal mühendislik biçimlerine de güç veriyor:

- Ses klonlama saldırıları, banka havaleleri gibi acil eylemleri tetiklemek için kısa ses örnekleri kullanarak yöneticileri taklit eder

- Deepfake saldırıları yüksek bahisli dolandırıcılıklar için görüntülü görüşme veya uzaktan toplantı simülasyonu yapıyor

Yakın zamanda yaşanan bir olayda, saldırganlar sosyal yardım kayıtları sırasında yapay zeka tarafından oluşturulan e-postaları kullanarak, kendilerini İK olarak tanıtıp kimlik bilgilerini çaldı ve çalışan kayıtlarına erişim sağladı. Tehlike güven yanılsamasında yatıyor. Bir e-posta dahili göründüğünde, ses tanıdık geldiğinde ve talep acil gibi hissettirdiğinde, eğitimli personel bile kandırılabilir.

Yapay Zeka Güvenlik Açığı Keşfi ve İstismarı

Yapay zeka, saldırganların yazılım açıklarını bulma ve bunlardan yararlanma yöntemlerini hızlandırıyor. Bir zamanlar günlerce süren manuel problama artık keşif ve istismar üretimi için eğitilmiş makine öğrenimi modelleri kullanılarak dakikalar içinde yapılabiliyor.

Tehdit aktörleri, halka açık sistemlerde güvenlik açığı taramasını otomatikleştirmek, zayıf yapılandırmaları, güncel olmayan yazılımları veya yamalanmamış CVE'leri belirlemek için yapay zekayı kullanır. Geleneksel araçların aksine yapay zeka, saldırganların yüksek değerli hedefleri önceliklendirmesine yardımcı olmak için maruz kalma bağlamını değerlendirebilir.

Yaygın yapay zeka destekli istismar taktikleri şunlardır:

- Sıfırıncı gün güvenlik açıklarını daha hızlı ortaya çıkarmak için otomatik fuzzing

- Uzaktan kod çalıştırma veya yanal hareket için özel komut dosyası oluşturma

- Örüntü öğrenme ve olasılıksal modellerle optimize edilmiş şifre kırma ve kaba kuvvet saldırıları

- Yüksek riskli varlıklar için ağları minimum gürültü ile tarayan keşif botları

LLaMA, Mistral veya Gemma gibi üretici modeller, sisteme özgü özelliklere dayalı olarak shellcode veya enjeksiyon saldırıları gibi özel yükler üretmek için ince ayar yapılabilir ve genellikle ticari modellerde yerleşik güvenlik önlemlerini atlayabilir.

Trend açık: Yapay zeka, saldırganların makine hızında güvenlik açıklarını keşfetmesini ve bunlara göre hareket etmesini sağlıyor. Ponemon Enstitüsü'ne göre, siber güvenlik uzmanlarının %54'ü yapay zeka destekli saldırılar çağında yamalanmamış güvenlik açıklarını en büyük endişe kaynağı olarak görüyor.

Yapay Zeka Odaklı Kötü Amaçlı Yazılımlar ve Fidye Yazılımları

Yapay zeka tarafından üretilen kötü amaçlı yazılımların yükselişi, geleneksel savunmaların artık tek başına yeterli olmadığı anlamına geliyor. Saldırganlar artık düşünen, adapte olan ve kaçan araçlara sahipler - çoğu zaman insan savunucuların yanıt verebileceğinden daha hızlı.

Yapay zeka destekli fidye yazılımları ve polimorfik kötü amaçlı yazılımlar, siber saldırıların nasıl geliştiğini yeniden tanımlıyor. Saldırganlar artık statik yükler yazmak yerine, tespit edilmekten kaçınmak için sürekli değişen polimorfik kötü amaçlı yazılım kodu oluşturmak için yapay zekayı kullanıyor.

Fidye yazılımı tehditleri de gelişiyor. Yapay zeka, hangi dosyaların şifreleneceğini seçmeye, sistem değerini analiz etmeye ve patlama için en uygun zamanlamayı belirlemeye yardımcı olabilir. Bu modeller ayrıca coğrafi sınırlama, sandbox atlatma ve bellek içi yürütme gibi genellikle gelişmiş tehdit aktörleri tarafından kullanılan teknikleri otomatikleştirebilir.

Yapay zeka ile veri sızıntısı, tespitten kaçmak için dinamik olarak adapte olur. Algoritmalar, trafik düzenlerini analiz ederek ve tespit tetikleyicilerinden kaçınarak verileri sıkıştırabilir, şifreleyebilir ve gizlice çıkarabilir. Bazı kötü amaçlı yazılım ajanları stratejik kararlar almaya başlıyor: tehlikeye atılmış ortamda gözlemlediklerine dayanarak ne zaman, nerede ve nasıl veri sızdıracaklarını seçiyorlar.

Yapay Zeka Siber Saldırı Örnekleri

Yapay zeka siber saldırıları artık teorik değil; veri çalmak, savunmaları aşmak ve büyük ölçekte insanları taklit etmek için zaten kullanıldılar.

Aşağıdaki üç önemli kategoride yer alan örnekler, saldırganların siber saldırılarda ciddi hasara yol açmak için artık gelişmiş becerilere ihtiyaç duymadığını göstermektedir. YZ, saldırı hızını, ölçeğini ve gizliliğini artırırken giriş engelini düşürüyor. Savunucular, yapay zeka ile entegre sistemleri proaktif olarak test ederek ve hem teknik manipülasyonu hem de insan aldatmacasını hesaba katan güvenlik önlemleri uygulayarak uyum sağlamalıdır.

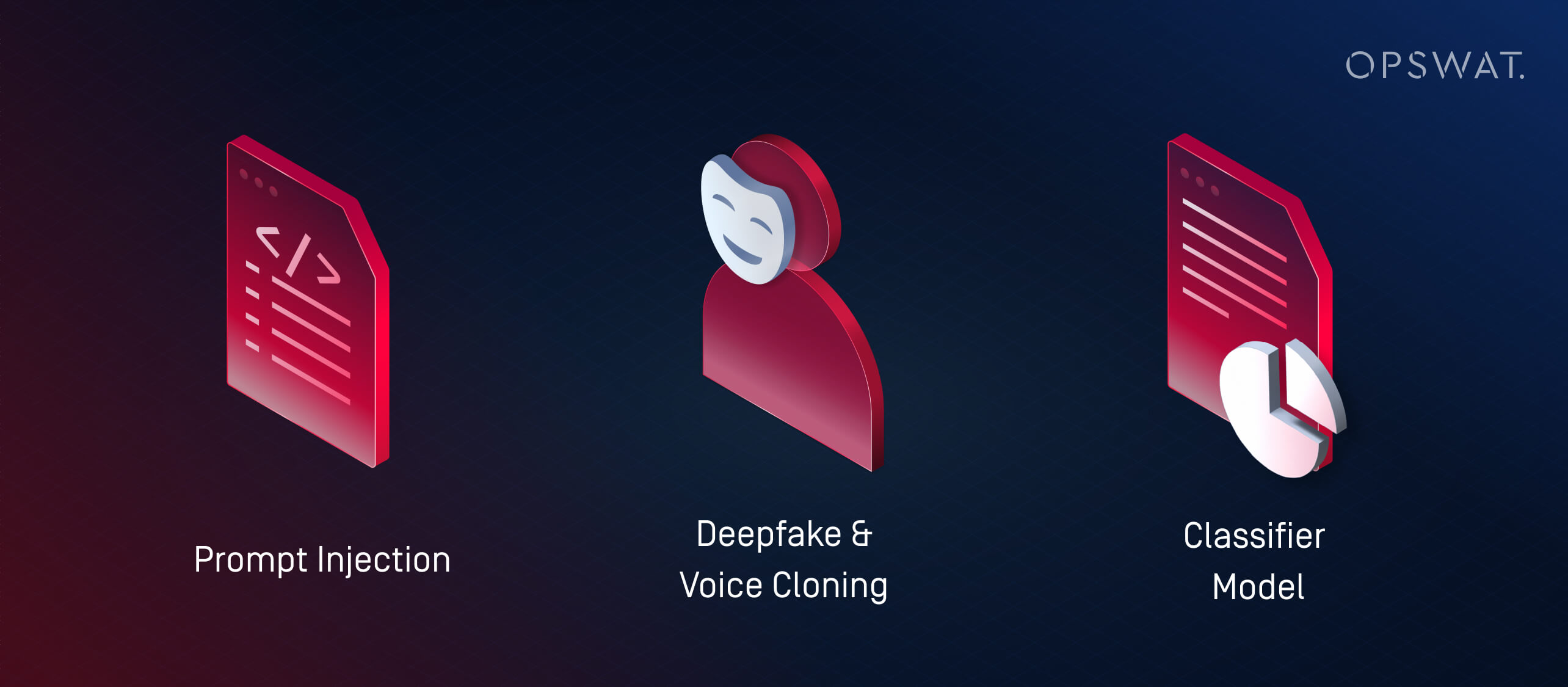

1. Prompt Injection Saldırıları Nedir?

İstem enjeksiyonu, saldırganların LLM'lerdeki (büyük dil modelleri) güvenlik açıklarını, amaçlanan davranışı geçersiz kılmak için tasarlanmış özel olarak hazırlanmış girdilerle besleyerek kullandıkları bir tekniktir. Bu saldırılar, LLM'lerin talimatları yorumlama ve önceliklendirme şeklini istismar eder ve genellikle geleneksel kötü amaçlı yazılımlar çok az yer alır veya hiç yer almaz.

Harici saldırılar başlatmak için YZ kullanmak yerine, istem enjeksiyonu bir kuruluşun kendi YZ sistemlerini farkında olmadan tehlikeye atan aracılara dönüştürür. Bir LLM, yardım masaları, sohbet robotları veya belge işlemcileri gibi araçlara uygun güvenlik önlemleri olmadan yerleştirilirse, bir saldırgan modelin daha sonra yorumladığı ve harekete geçtiği gizli komutlar yerleştirebilir. Bu durum şu sonuçlara yol açabilir:

- Özel veya kısıtlı verilerin sızdırılması

- İstenmeyen eylemlerin gerçekleştirilmesi (örn. e-posta gönderme, kayıtları değiştirme)

- Yanlış bilgi yaymak veya takip eden eylemleri tetiklemek için çıktıyı manipüle etmek

Bu riskler, birden fazla modelin birbirleri arasında bilgi aktardığı sistemlerde artar. Örneğin, bir belgeye yerleştirilmiş kötü niyetli bir bilgi istemi, bir yapay zeka özetleyicisini etkileyebilir ve bu özetleyici de daha sonraki sistemlere hatalı bilgiler aktarabilir.

Yapay zeka iş akışlarına daha entegre hale geldikçe, saldırganlar güveni tehlikeye atmak, veri çıkarmak veya kararları içten dışa manipüle etmek için bu modelleri giderek daha fazla hedef alıyor.

2. Deepfake ve Ses Klonlama Saldırıları Nedir?

Deepfake saldırıları, insanları gerçek zamanlı olarak taklit etmek için yapay zeka tarafından üretilen ses veya video kullanır. Sosyal mühendislik taktikleriyle eşleştirilen bu araçlar dolandırıcılık, kimlik bilgisi hırsızlığı ve yetkisiz sistem erişimi için kullanılıyor.

Ses klonlama özellikle tehlikeli hale gelmiştir. Tehdit aktörleri, sadece birkaç saniyelik kaydedilmiş konuşmayla ton, hız ve tonlamayı taklit eden sesler oluşturabilir. Bu klonlanmış sesler daha sonra şu amaçlarla kullanılıyor:

- Acil aramalar sırasında yöneticilerin veya müdürlerin kimliğine bürünmek

- Çalışanları banka havaleleri veya şifre sıfırlamaları için kandırın

- Sesli kimlik doğrulama sistemlerini atlayın

Deepfake'ler sentetik videolar üreterek bunu bir adım öteye taşır. Tehdit aktörleri, gizli veri talep eden bir video görüşmesinde bir CEO'yu taklit edebilir veya dezenformasyon yayan politika değişikliklerini "duyuran" kaydedilmiş kliplerde görünebilir. Ponemon Enstitüsü, saldırganların bir şirketin sosyal yardım kayıt döneminde İK'yı taklit eden yapay zeka tarafından oluşturulmuş mesajlar kullandığı ve kimlik bilgilerinin çalınmasına yol açan bir olay bildirdi.

Yapay zeka araçları daha erişilebilir hale geldikçe, küçük çaplı tehdit aktörleri bile yüksek doğrulukta taklitler oluşturabilir. Bu saldırılar, güveni istismar ederek geleneksel spam filtrelerini veya uç nokta savunmalarını atlatır.

3. Sınıflandırıcı Model Saldırıları (Adversarial Machine Learning) nedir?

Sınıflandırıcı model saldırıları, kötü amaçlı yazılım yazmak veya kodu istismar etmek zorunda kalmadan yanlış kararları zorlamak için bir AI sisteminin girdilerini veya davranışını manipüle eder. Bu taktikler daha geniş bir kategori olan düşmanca makine öğrenimi kapsamına girer.

İki temel strateji vardır:

- Kaçırma saldırıları: Saldırgan, antivirüs motorlarını atlatmak için zararsız dosyaları taklit eden kötü amaçlı yazılımlar gibi bir sınıflandırıcıyı yanlış tanımlaması için kandıran bir girdi oluşturur

- Zehirleme saldırıları: Bir model kasıtlı olarak çarpıtılmış veriler üzerinde eğitilir veya ince ayar yapılır, böylece tehditleri tespit etme yeteneği değiştirilir

Denetimli modeller genellikle "aşırı uyum sağlar": eğitim verilerinden belirli kalıpları öğrenirler ve çok az sapma gösteren saldırıları gözden kaçırırlar. Saldırganlar, bilinen tespit sınırlarının hemen dışında yükler oluşturmak için WormGPT (saldırı görevleri için ince ayarlanmış açık kaynaklı bir LLM) gibi araçlar kullanarak bu durumdan yararlanırlar.

Bu, sıfırıncı gün istismarının makine öğrenimi versiyonudur.

Yapay Zeka Hackleme ve Geleneksel Hackleme: Temel Farklılıklar

Yapay zeka korsanları, yapay zeka siber saldırılarını otomatikleştirmek, geliştirmek ve ölçeklendirmek için yapay zekayı kullanır. Buna karşılık, geleneksel bilgisayar korsanlığı genellikle manuel komut dosyası oluşturma, derin teknik uzmanlık ve önemli zaman yatırımı gerektirir. Temel fark hız, ölçeklenebilirlik ve erişilebilirlikte yatıyor: acemi saldırganlar bile artık birkaç komut istemi ve tüketici sınıfı bir GPU ile sofistike yapay zeka destekli siber saldırılar başlatabilir.

Aspect | Yapay Zeka Hackleme | Geleneksel Hackleme |

|---|---|---|

Hız | Otomasyon ile neredeyse anında | Daha yavaş, manuel komut dosyası oluşturma |

Beceri Gereksinimleri | İstem tabanlı; düşük giriş engeli, ancak model erişimi ve ayarlama gerektirir | Yüksek; derin teknik uzmanlık gerektirir |

Ölçeklenebilirlik | Yüksek - birçok hedefe yönelik çok aşamalı saldırıları destekler | İnsan zamanı ve çabası ile sınırlıdır |

Uyarlanabilirlik | Dinamik - Yapay zeka yükleri ve kaçışları gerçek zamanlı olarak ayarlar | Statik veya yarı uyarlanabilir komut dosyaları |

Saldırı Vektörleri | LLM'ler, derin sahtecilikler, sınıflandırıcı model saldırıları, otonom ajanlar | Kötü amaçlı yazılım, kimlik avı, manuel keşif ve istismarlar |

Uyarılar | Tahmin edilemez olabilir; insan gözetimi olmadan niyet ve bağlamdan yoksundur | Daha stratejik kontrol, ancak daha yavaş ve manuel |

Yapay Zekanın Kötüye Kullanımı ve Muhalif Makine Öğrenimi

Tüm YZ tehditleri kötü amaçlı yazılım üretmeyi içermez; bazıları YZ sistemlerinin kendisini hedef alır. İstem enjeksiyonu ve model zehirleme gibi saldırgan makine öğrenimi taktikleri sınıflandırıcıları manipüle edebilir, algılamayı atlayabilir veya karar verme sürecini bozabilir. YZ güvenlik iş akışlarının merkezi haline geldikçe, bu saldırılar sağlam testlere ve insan gözetimine olan acil ihtiyacı vurgulamaktadır.

Yapay Zeka Kötü Amaçlı Yazılım Geliştirmek İçin Nasıl Kötüye Kullanılabilir? Bir OPSWAT Uzman Analizi

Eskiden ileri düzey beceriler gerektiren şeyler artık komutlar ve birkaç tıklama gerektiriyor.

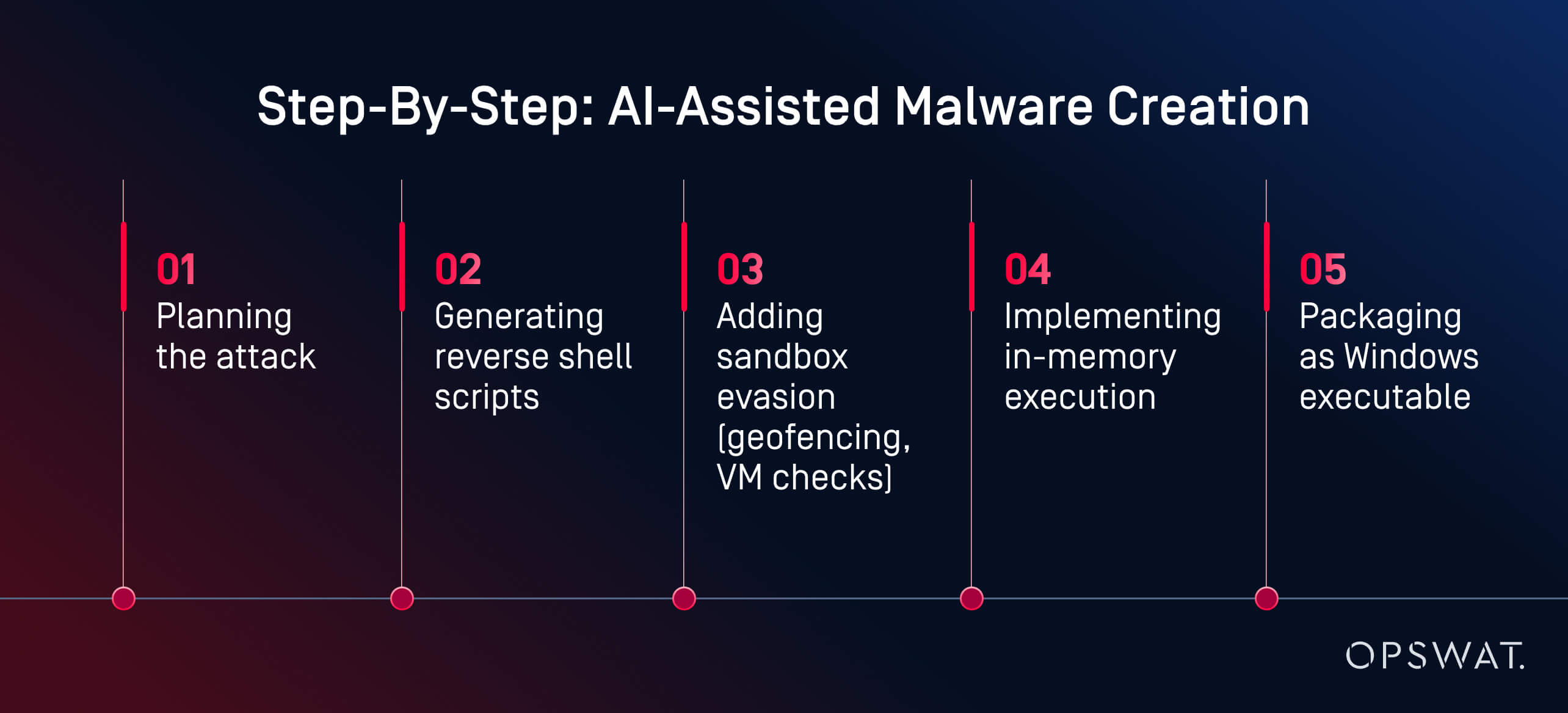

OPSWAT siber güvenlik uzmanı Martin Kallas, canlı bir deneyde, yapay zeka araçlarının hızlı, ucuz ve gelişmiş beceriler olmadan kaçamak kötü amaçlı yazılım oluşturmak için nasıl kullanılabileceğini gösterdi. Martin, HackerGPT'yi kullanarak iki saatten kısa bir sürede tam bir kötü amaçlı yazılım zinciri oluşturdu. Model ona her aşamada rehberlik etti:

Martin, "Yapay zeka bana her aşamada rehberlik etti: planlama, gizleme, kaçınma ve yürütme," diye açıkladı. Sonuç "... VirusTotal'daki 63 antivirüs motorundan 60'ı tarafından tespit edilmekten kurtulan, yapay zeka tarafından oluşturulmuş bir yük oldu." Davranışsal analiz ve sandboxing de bu yükü zararlı olarak işaretleyemedi.

Bu bir ulus-devlet değildi. Siyah şapkalı bir hacker da değildi. Tüketici sınıfı bir GPU üzerinde halka açık araçları kullanan motive olmuş bir analistti. Anahtar kolaylaştırıcı? Yerel olarak barındırılan, sınırsız yapay zeka modelleri. Hugging Face gibi platformlarda bulunan bir milyondan fazla açık kaynaklı model ile saldırganlar geniş bir kütüphaneden seçim yapabilir, kötü niyetli amaçlar için ince ayar yapabilir ve gözetim olmadan çalıştırabilir. Bulut tabanlı hizmetlerin aksine, yerel LLM'ler güvenlik önlemlerini göz ardı edecek ve saldırgan görevleri yerine getirecek şekilde yeniden programlanabilir.

"Bu, motive olmuş bir amatörün inşa edebileceği bir şey. Bir ulus-devletin neler yapabileceğini hayal edin" diye uyarıyor Martin. Martin'in verdiği örnek, yapay zekanın kötüye kullanımının siber suçu nasıl yetenekli bir meslekten erişilebilir, yapay zeka destekli bir iş akışına dönüştürebileceğini gösteriyor. Bugün, kötü amaçlı yazılım oluşturma artık bir darboğaz değil. Tespit, saldırganların artık parmaklarının ucunda olan araçlardan daha hızlı gelişmelidir.

Yapay Zeka Destekli Siber Saldırılara Karşı Nasıl Savunma Yapılır?

Sadece daha akıllı tespit değil, katmanlı savunmaya ihtiyacımız var.

Sistemleri yapay zeka destekli siber saldırılara karşı savunmak, otomasyonu insan içgörüsüyle ve önlemeyi tespitle birleştiren çok katmanlı bir strateji gerektirir. OPSWAT'ın gelişmiş tehdit önleme platformu gibi önde gelen yapay zeka destekli siber güvenlik çözümleri, önleme ve tespiti entegre eder. Daha fazla bilgi edinmek için videoyu izleyin.

Yapay Zeka Güvenlik Testi ve Kırmızı Ekip Oluşturma

Birçok kuruluş, LLM'nin kötüye kullanımı, istem enjeksiyonu ve sınıflandırıcıdan kaçmaya karşı savunmalarını test etmek için yapay zeka destekli kırmızı ekip oluşturmaya yöneliyor. Bu simülasyonlar, yapay zeka ile entegre sistemlerdeki güvenlik açıklarının saldırganlardan önce ortaya çıkarılmasına yardımcı oluyor.

Kırmızı ekipler , sistemlerin dirençli veya istismara açık olup olmadığını değerlendirmek için düşmanca istemler, sentetik kimlik avı ve yapay zeka tarafından oluşturulan yükleri kullanır. Yapay zeka güvenlik testi ayrıca şunları içerir:

- Hızlı enjeksiyon riskleri için bulanıklaştırma modelleri

- LLM'lerin manipüle edilmiş veya zincirleme girdileri nasıl işlediğinin değerlendirilmesi

- Sınıflandırıcının kaçamak davranışlara karşı sağlamlığının test edilmesi

Güvenlik liderleri de kendi LLM'lerini hızlı sızıntı, halüsinasyon veya dahili mantığa istenmeyen erişim için taramaya başlıyorlar ki bu, üretken yapay zekanın ürünlere ve iş akışlarına yerleştirilmesinde çok önemli bir adım.

Daha Akıllı Bir Savunma Yığını: OPSWAT'ın Yaklaşımı

Martin Kallas, reaktif bir döngü içinde "yapay zekayla yapay zekayla savaşmaya" çalışmak yerine, çok katmanlı, proaktif bir savunmayı savunuyor. OPSWAT çözümleri, tehdit yaşam döngüsünün tamamını hedef alan teknolojileri bir araya getiriyor:

- Metascan™ Multiscanning: Tek AV motorlu sistemler tarafından gözden kaçırılan tehditleri tespit etmek için dosyaları birden fazla antivirüs motorunda çalıştırır

- MetaDefender : İzole ortamlarda dosya davranışını analiz eder, hatta statik kuralları atlatan yapay zeka tarafından oluşturulan yükleri bile algılar.

- Deep CDR™ Teknolojisi: Dosyaları güvenli sürümler halinde yeniden oluşturarak ve gömülü istismarları ortadan kaldırarak tehditleri etkisiz hale getirir.

Bu katmanlı güvenlik yığını, polimorfik tehditler, bellek içi yükler ve geleneksel araçları atlatan deepfake yemleri de dahil olmak üzere yapay zeka tarafından üretilen kötü amaçlı yazılımların öngörülemeyen doğasına karşı koymak için tasarlanmıştır. Her katman saldırı zincirinin farklı bir aşamasını hedef aldığından, tehdidi tespit etmek veya etkisiz hale getirmek ve zarar vermeden önce tüm operasyonu çökertmek için yalnızca bir tanesi yeterlidir.

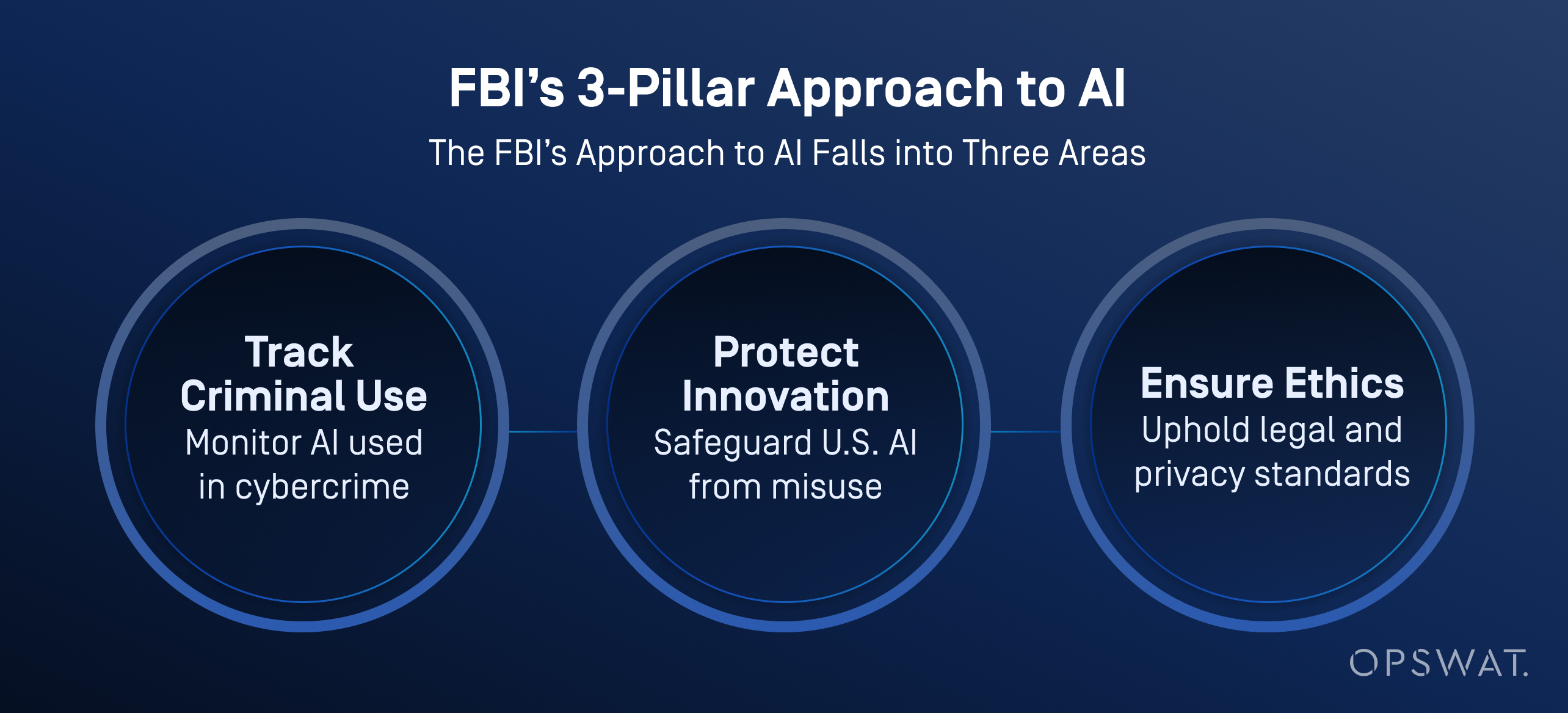

Sektör Kullanım Örnekleri: FBI Hangi Yapay Zekayı Kullanıyor?

FBI ve diğer ABD kurumları, yapay zekayı siber savunma operasyonlarına yalnızca tehditleri önceliklendirmek için değil, aynı zamanda veri analizini, video analitiğini ve ses tanımayı geliştirmek için de giderek daha fazla entegre ediyor.

FBI'a göre yapay zeka, araç tanıma, dil tanımlama ve konuşmayı metne dönüştürme dahil olmak üzere soruşturma ipuçlarını oluşturmak için büyük hacimli verilerin işlenmesine yardımcı oluyor. Daha da önemlisi, büro sıkı bir insan gözetimi uygulamaktadır: YZ tarafından üretilen tüm çıktılar, herhangi bir işlem yapılmadan önce eğitimli müfettişler tarafından doğrulanmalıdır.

YZ, insan karar verme mekanizmasının yerine geçmez. FBI, soruşturma sonuçlarından her zaman bir insanın sorumlu olduğunu ve YZ'nin mahremiyete, sivil özgürlüklere ve yasal standartlara saygı gösterecek şekilde kullanılması gerektiğini vurgulamaktadır.

Kuruluşlar Hazır mı?

Ponemon'un Yapay Zeka Siber Güvenlik Durumu Raporu'nda belirtildiği üzere, yapay zeka kaynaklı tehditlerdeki artışa rağmen, güvenlik uzmanlarının yalnızca %37'si yapay zeka destekli bir siber saldırıyı durdurmaya hazır hissettiklerini söylüyor. Birçoğu hala modası geçmiş siber risk yönetimi planlarına ve reaktif tespit stratejilerine güveniyor.

İleriye giden yol 4 temel adım gerektirmektedir:

- Yapay zeka farkındalığına sahip savunma araçlarının daha hızlı benimsenmesi

- Sürekli kırmızı ekip çalışması ve hızlı risk testi

- Multiscanning, CDR ve sandboxing'in aktif kullanımı

- SOC analistlerinin otomatik soruşturma araçlarıyla birlikte çalışacak şekilde eğitilmesi

Yapay zeka kuralları değiştirdi. Mesele insanların yerini almak değil, onlara artık kendi kendilerine düşünen saldırıları geride bırakacak araçlar sağlamak. Platformumuzun BT ve OT ortamlarında dosyaların, cihazların ve veri akışlarının güvenliğini sağlamaya nasıl yardımcı olduğunu keşfedin.

Sıkça Sorulan Sorular (SSS)

Yapay zeka korsanlığı nedir?

Yapay zeka korsanlığı, siber saldırıları otomatikleştirmek veya geliştirmek için büyük dil modelleri (LLM'ler) gibi araçların kullanılmasıdır. Saldırganların kötü amaçlı yazılım oluşturmasına, kimlik avı kampanyaları başlatmasına ve savunmaları eskisinden daha hızlı ve daha kolay bir şekilde atlatmasına yardımcı olur.

Yapay zeka siber suçlar için nasıl kullanılıyor?

Suçlular yapay zekayı kötü amaçlı yazılım üretmek, kimlik avını otomatikleştirmek ve güvenlik açığı taramalarını hızlandırmak için kullanıyor. Hatta dark web forumlarında satılanlar gibi bazı araçlar saldırganlara tam saldırı zincirleri boyunca yol gösterebiliyor.

Yapay zeka korsanlığı ile geleneksel korsanlık arasındaki fark nedir?

Geleneksel bilgisayar korsanlığı uygulamalı kodlama, araç kullanımı ve teknik beceriler gerektirir. Yapay zeka korsanlığı, basit komutlardan yükler, komut dosyaları ve kimlik avı içeriği oluşturan modellerle bu engeli azaltır. Bu teknikler saldırıları daha hızlı, daha ölçeklenebilir ve amatörler için erişilebilir hale getirir.

Yapay zeka kötü amaçlı yazılım geliştirmek için nasıl kötüye kullanılabilir?

Yapay zeka, çok az girdi ile polimorfik kötü amaçlı yazılımlar, ters kabuklar ve kum havuzuna zarar veren yükler üretebilir. Canlı bir OPSWAT demosunda gösterildiği gibi, kötü niyetli olmayan bir kullanıcı, bir oyun bilgisayarında çalışan açık kaynaklı AI modellerini kullanarak iki saatten kısa bir sürede neredeyse sıfır gün kötü amaçlı yazılım oluşturdu.

Yapay zeka bilgisayar korsanlarının yerini alabilir mi?

Henüz değil, ancak birçok teknik görevi yerine getirebilir. Hackerlar hala hedefleri ve amaçları seçerken, yapay zeka kod yazıyor, tespitten kaçıyor ve saldırıları uyarlıyor. Asıl risk, yapay zekanın hızıyla güçlenen insan saldırganlardır.

Yapay zeka hacker'ı nedir?

YZ hacker, siber saldırılar başlatmak, kötü amaçlı yazılımları otomatikleştirmek veya büyük ölçekte kimlik avı kampanyaları yürütmek için YZ kullanan bir kişi veya yarı otonom bir sistemdir.

FBI hangi yapay zekayı kullanıyor?

FBI, tehdit önceliklendirme, adli analiz, anomali tespiti ve dijital kanıt işleme için yapay zeka kullanıyor. Bu araçlar, analistin iş yükünü azaltırken soruşturmaların otomatikleştirilmesine ve yüksek öncelikli vakaların ortaya çıkarılmasına yardımcı oluyor.

Yapay zeka saldırısına örnek nedir?

Gerçek dünyadaki vakalardan biri, bir şirketin sosyal yardım kayıt dönemi sırasında yapay zeka tarafından oluşturulan kimlik avı e-postalarını içeriyordu. Saldırganlar, kimlik bilgilerini çalmak için İK'yı taklit etti. Bir diğerinde ise yapay zeka, fidye yazılımı hedeflemesinin otomatikleştirilmesine yardımcı olarak çok uluslu bir markayı operasyonlarını durdurmaya zorladı.

Yapay zeka siber saldırıları nedir?

YZ siber saldırıları, yapay zeka yardımıyla geliştirilen veya yürütülen tehditlerdir. Örnekler arasında yapay zeka tarafından oluşturulan kimlik avı, deepfake taklitleri, hızlı enjeksiyon ve sınıflandırıcıdan kaçınma yer almaktadır. Bu saldırılar genellikle geleneksel savunmaları atlatır.

Bilgisayar korsanları ve dolandırıcılar insanları hedef almak için yapay zekayı nasıl kullanıyor?

Bilgisayar korsanları, kimlik avı e-postalarını kişiselleştirmek, telefon dolandırıcılığı için sesleri klonlamak ve hedefleri aldatmak için deepfake videolar oluşturmak için yapay zekayı kullanıyor. Bu taktikler insan güvenini istismar etmekte ve iyi eğitimli kullanıcıları bile gerçekçi, yapay zeka tarafından hazırlanmış aldatmacalara karşı savunmasız hale getirmektedir.

Yapay zeka destekli saldırılara karşı nasıl savunma yapabilirim?

Katmanlı bir savunma kullanın: Multiscanning, sandboxing, CDR ve insan liderliğindeki kırmızı ekip. Yapay zeka saldırıları hızlı hareket eder. Savunucuların buna ayak uydurmak için otomasyona, bağlama ve hıza ihtiyacı vardır.